Ola gente dia a todos gostaria da opinião de vocês pra saber qual o melhor ou qual protocolos vocês usam ou preferem para conversa com amigos ou familiares?? Atualmente estou usando o xmpp q é meu preferido mas cheguei a testar o matrix e achei bem interessante os apps moderno e as opções de pontes. Vocês acham q matrix está maduro suficiente pras coisas q mencionei ali em cima ou melhor ficar com xmpp?

Obs: talvez se eu fosse usar matrix iria auto hospedar ele pra usar e tals

Tenho feito selfhost de uma instância do matrix desde o ano passado.

A ideia era criar um mirror do grupo de trabalho do telegram (que vinha sendo ameaçado de bloqueios na época) e migrar pro matrix caso fosse necessário.

No fim, o meu provedor “esqueceu” de bloquear o telegram e acabou dando em nada.

Assim o matrix continuou só como um mirror e aproveitei para botar uma bridge do meu whatsapp pessoal lá, principalmente pra deixar rodando um script pra transcrever as mensagens de áudio que eu recebo e agora não consigo mais ficar sem isso.

Na época eu tinha optado por usar o Dendrite, que dizia ser uma versão mais enxuta do que o Synapse (que é o servidor padrão). Tava tudo redondo, até que recentemente as bridges foram atualizadas e passaram a precisar da api versão 1.4, mas o Dendrite meio que estagnou e tá empacado na api 1.2 ainda.

Então tentei instalar o Synapse aqui, mas aleatoriamente ele começa a comer 35% da CPU (de um i5-4590). Se eu reiniciar o container dele, normaliza por um tempo, mas depois de algumas horas volta a pesar de novo.

O próximo passo vai ser testar o Matrix Conduit pra ver :|

@thes0ls @GeofSux66 cara, uma coisa muito interessante isso de ter um auto audio transcrevedor, poderia indicar como construiu esse grande alívio para as dores da vida no “zapzap” talvez algum repositório??? rsrsr

Hahah, tá no meio de um script enorme que eu também uso pra fazer o mirror das outras mensagens. Qualquer coisa alguma hora eu vejo se tento isolar só isso, mas pra dar um início seria:

Um script python com nio, que serve pra conectar no servidor, logar na conta e ficar espiando as mensagens que vão chegando.

Quando ele encontrar uma mensagem de áudio, eu faço ele baixar o arquivo numa pasta local e depois eu rodo o whisper hospedado localmente pra fazer a transcrição.

Depois com o resultado, eu tenho duas opções, enviar de volta o áudio para o mesmo chat, ou enviar pra um chat privado só comigo. Quando é com alguém chegado, eu envio pro mesmo chat, já o restante eu faço vir em separado.

Inicialmente eu usava o sr*, mas se a pessoa tinha um pouco de sotaque, o reconhecimento não funcionava legal.

Com o whisper o resultado é bem melhor, porém é bem mais pesado e demora um tanto pra transcrever. Um áudio de 30 segundos leva uns 3~4 minutos. Mas se a pessoa quis economizar o tempo dela enviando em audio, não deve se importar de esperar uns 5 minutos pra receber uma resposta do outro lado… hahah

*EDIT: Uma correção, o meu script também tava com o tesseract sendo usado em outro trecho, por isso eu confundi, mas a parte do audio era usando o SpeechRecognition. Foi mals. EDIT

Welp que eu acabei mesmo passando a limpo o meu script.

Aqui estou levando em conta que o matrix já está com a bridge rodando e o script vai cuidar só de espiar se chega mensagem de áudio.

Quem for usar, leia o código que eu botei uns comentários nos trechos que deve editar.

Testei só no meu próprio ambiente, então pode ser que tenha uma dependência ou outra que esqueci de anotar (nem lembro como que instalei o whisper, por exemplo).

A documentação do nio fica em aqui: https://matrix-nio.readthedocs.io/en/latest/index.html

# -*- coding: utf-8 -*- import requests import os import re import time import whisper import asyncio import json from nio import AsyncClient, MatrixRoom, RoomMessageText, RoomMessageAudio, Api # whisper requer o ffmpeg: # sudo apt update && sudo apt install ffmpeg # E no virtualenv do seu python, os requisitos provavelmente são: # pip install asyncio openai-whisper matrix-nio # Analisar o restante do script e substituir os valores do room_id na função audio_callback pelos da sua instância # ------------------------------------------------ # Credenciais do login. Pegar os dados da response: # curl -XPOST -d '{"type":"m.login.password", "user":"NOMEDOUSUARIO", "password":"SENHADOUSUARIO"}' "https://matrix.zzz/_matrix/client/r0/login" CONFIG_FILE = "matrix-credentials.json" if not os.path.isfile(CONFIG_FILE): f = open(CONFIG_FILE, 'w') f.write('{"user_id":"@usuario:matrix.zzz","access_token":"abc123","home_server":"https://matrix.zzz","device_id":"ABCD"}') f.close() print('Preencha as credenciais...') exit() # Este arquivo é usado pro script ignorar mensagens anteriores a data dele lastruntime='matrix.time.txt' if not os.path.isfile(lastruntime): f = open(lastruntime, 'w') f.write("0") f.close() # Pasta onde ficarão salvos os áudio temporários if not os.path.isdir("matrixtemp"): os.mkdir("matrixtemp") with open(CONFIG_FILE, "r") as f: config = json.load(f) client = AsyncClient(config["home_server"]) client.access_token = config["access_token"] client.user_id = config["user_id"] client.device_id = config["device_id"] async def matrix_message(text, room_id, server_timestamp, in_reply_to = 0): event_type="m.room.message" msgtype="m.text" if in_reply_to == 0: content = { "msgtype": msgtype, "body": cleanhtml(text), "format": "org.matrix.custom.html", "formatted_body": text } else: content = { "m.relates_to": {"m.in_reply_to": {"event_id": in_reply_to } }, "msgtype": msgtype, "body": cleanhtml(text), "format": "org.matrix.custom.html", "formatted_body": text } await client.room_send( room_id, message_type="m.room.message", content=content, ignore_unverified_devices=True, ) f = open(lastruntime, "w") f.write(str(server_timestamp)) f.close() CLEANR = re.compile('<.*?>') def cleanhtml(raw_html): cleantext = re.sub(CLEANR, '', raw_html) return cleantext async def audio_callback(room: MatrixRoom, event: RoomMessageAudio) -> None: # Aqui os chats que podem receber a transcrição na própria conversa. # Pra pegar o id, no Element, clique direito na sala, Settings > Advanced > Internal room ID permitidos=[ "!AsasasASas:matrix.zzz", "!Idasasas:matrix.zzz" ] if room.room_id in permitidos: room_id = room.room_id event_id = event.event_id else: room_id = "!BHBhbHBHbhb:matrix.zzz" # Aqui especifica o room_id do chat que vai receber fora dos permitidos acima event_id = 0 sender = event.source['sender'] lastrun = open(lastruntime, "r") lastrun = lastrun.read() if event.server_timestamp > int(lastrun): print(vars(room)) print(event) dllink = Api.mxc_to_http(event.source['content']['url']) print(dllink) filename = os.path.basename(dllink)+".ogg" filepath = "./matrixtemp/"+filename r = requests.get(dllink) print(r.status_code) with open(filepath, 'wb') as f: f.write(r.content) print("iniciando openai/whisper") start = time.time() model = whisper.load_model("medium") whisperconfig="bs3" #def p2bs5 bs3 bs2 if whisperconfig == "p2bs5": result = model.transcribe(filepath, language="pt", fp16=False, verbose=True, patience=2, beam_size=5) #580 segundos if whisperconfig == "def": result = model.transcribe(filepath, language="pt", fp16=False, verbose=True) #56 segundos if whisperconfig == "bs3": result = model.transcribe(filepath, language="pt", fp16=False, verbose=True, beam_size=3) #181 segundos if whisperconfig == "bs2": result = model.transcribe(filepath, language="pt", fp16=False, verbose=True, beam_size=2) #136 segundos end = time.time() tempogasto = int(end - start) print("Conluido, tempo gasto: "+ str(tempogasto)) text = result["text"] await matrix_message("<b>Transcrição:</b><br/><br/>"+sender+":<br/> "+text, room_id, str(event.server_timestamp), event_id) async def main() -> None: client.add_event_callback(audio_callback, RoomMessageAudio) await client.sync_forever(timeout=30000) # milliseconds asyncio.run(main())EDIT: 2024-03-27 21h50: Corrigi um erro de copicola logo depois do

if not os.path.isfile(CONFIG_FILE):.Só pra ficar registrado, não sei se os edits estão sendo federados corretamente, então o link pra versão mais atualizada tá aqui: https://lemmy.eco.br/comment/6300628

Krai esse matrix consome pra krl huagys melhor ficar no xmpp mesmo alias gastou quanto pra criar servidor doméstico?

O problema é que é totalmente aleatório. Ontem às 22h tava comendo os 35% de novo. Reiniciei o container e tá até agora rodando bonitinho consumindo de 1% pra baixo.

No dendrite eu não tinha notado esses problemas.

alias gastou quanto pra criar servidor doméstico?

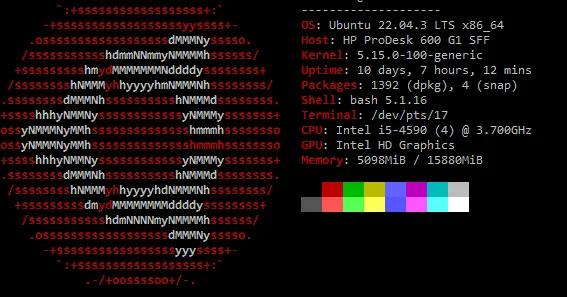

Um fornecedor do meu irmão tava se desfazendo de equipamentos antigos e peguei um “HP Prodesk 600 Slim”, acho que um i5 e 8gb de ram e um hdd mecânico de 500GB por uns R$600.

Só botei mais uns pentes de memória que eu tinha sobrando aqui e um ssd, que também tinha de sobra.

EDIT:

Btw, não sei se é bug, mas só consegui fazer o upload da imagem pela interface normal, tentando pelo old.lemmy só retornava erro.

Foda dms irmão foda q compra uns desse são caros

Olha, eu mantenho um servidor local rodando direto acho que faz uns 20 anos já.

Este é o primeiro mais potente que eu uso, o resto era tudo de PC baixo custo velho que a placa-mãe vinha até com processador já embutido. Muito provavelmente eram mais fracos que um raspberry pi 3 da vida.

Mesmo sendo fraquinhos, dava pra hospedar legal as coisas localmente. Só quando precisava compilar algo que tinha que ter uma paciência enorme.

Então, se a ideia é tentar brincar de selfhost, acho que dá pra começar com qualquer equipamento, seja um PC/notebook velho ou um raspberry da vida.

A propósito, vendo as mensagens antigas, o Synapse aqui normalizou depois de uns 2 dias e não voltou mais a comer processamento fora do normal.

Fico feliz q o synapse parou com a fome kkk se acha q vale pena pega um mini PC mesmo ou montar um bem baratinho ? Alias como faz os backup nos hdd no home server para se um ir de arrasta pra cima n perde as coisas

No meu caso foi reaproveitando PC velho mesmo, inclusive era tudo com os gabinetes grandões todo sucateado.

Mas dependendo da verba, até um raspberry pi pode ser interessante pra começar a mexer.

O legal do raspberry é que basta você trocar um cartão SD que você consegue ter um sistema operacional diferente. Então quando quiser brincar como servidor, coloca um cartão SD com um ubuntu server da vida e nem precisa ligar num monitor.

E se gostar de jogar joguinhos antigos, bota um SD com batocera ou coisa do tipo e liga numa tela via HDMI pra jogar uns Super Nintendo ou assistir coisas pelo Kodi.

Alias como faz os backup nos hdd no home server para se um ir de arrasta pra cima n perde as coisas

Acho que raid seja uma alternativa?

No meu caso, raid “desperdiçaria” muito hdd, então eu vou na fé e só programo as coisas mais importantes pra rodar uns backups periodicamente e salvar numa pasta que tá sincronizada via syncthing com o meu desktop.

Ata entendi interessante o foda q um raspberry talvez hj em dia ta meio carinho n?

Abri aqui o link da ursal.zone e vários comentários do mastodon não apareceram aqui no lemmy, então vamos ver se pelo menos a resposta chega.

@fbobraga@mastodon.social

esse esquema de mirror do Telegram/WhatsApp é bem legal: nem parece coisa aberta, parece ter algum contrato entre desenvolvedores do matrix e provedores dos serviços fechados pra possibilitar isso!

A bridge que eu uso não feita pelo próprio matrix, mas sim do maunium, que imagino que foi feito caçando as chamadas da api mesmo.

Parece que algo similar tem para o xmpp também: https://slidge.im/slidge-whatsapp/

sua conexão é qual ae?

Tenho fibra 600mbps, mas a maioria do que eu faço selfhost é pra uso pessoal e acaba sendo usado mais na rede local mesmo.

tesseract funciona com áudio? Achei que fosse só OCR

Falha minha. Fui caçar os scripts antigos aqui e ele também tinha o tesseract logo antes, mas na verdade era o sr. O tesseract de fato tava lá só pra lidar com imagens.

@noherotoots@ursal.zone

Queria entender o modus operandis, se é automático, se preciso deixar aberto em um navegador / sessão ativa para o bot fazer o processo e me devolver…

É um script em python, que roda como se fosse um app/client normal. No caso ele fica rodando de fundo o tempo todo no computador.

EDIT:

E pelo jeito eu falhei em como usar as mentions :v

Matrix é o mais completinho de todos que conheço, mas ele tem vários problemas relacionados a privacidade e tal. O XMPP é mais simples, não permite responder mensagens, nem editar mensagens além da ultima que você postou. É realmente bem bobinho, mas esse sim é realmente privado.

Agora da pra responder e editar mensagens sim

Só usar monocles chat

Eita, vou ver, valeu!

Foi nada po 🍷